چگونه داده های کثیف (Dirty Data) به چالشی ترین مشکل تیم های علم داده Data Science Team در شرکت های بزرگ و سازمان های عظیم بخش دولتی و خصوصی بدل می شود؟ آیا این معضل به جذابیت هایش مانند کسب بینش ناشی از تحلیل های دادهمحور، ارتقاء تجربه مشتریان و بهبود فرآیندها، می ارزد؟ در ادامه به تجزیه تحلیل این موظوع می پردازیم.

داده های کثیف (Dirty Data)؛ چالشی ترین مشکل تیم های علم داده

تشکیل تیم های تخصصی علم داده (Data Science Team) در سازمانها علاوه بر جذابیت هایی که دارد، همانند کسب بینش ناشی از تحلیل های داده محور، ارتقاء تجربه مشتریان، بهبود فرآیندها و ... دارای چالش های بزرگی نیز هست که در صورت عدم مدیریت آن، مشکلات متعددی در پروژهها و مدیریت تیم های علم داده ایجاد می کند.

در ادامه برخی از مهمترین چالشهای سازمانی دپارتمان های علم داده (Data Science) براساس نظرسنجی موسسه Business Broadway از 10 هزار متخصص این حوزه ذکر می شود.

1- وجود داده های کثیف (Dirty Data)

2- خلا وجود متخصصین و استعدادهای کافی علمداده در سازمان

3- عدم وجود سیاستها و فرهنگ سازمانی دادهمحور

4- پیچیدگی یا عدم دسترسی به اطلاعات و دادههای مورد نیاز

5- قابل استفاده نبودن نتایج پروژههای تحلیلداده در تصمیمات کسبوکار

6- توضیح کاربردها و کارکردهای علمداده به سایر واحدها و افراد سازمان

7- مشکلات حریم خصوصی

8- عدم همکاری و تعامل متخصصین کسب و کار با متخصصین علمداده

9- عدم دسترسی به منابع کافی جهت تشکیل تیم علمداده در شرکتهای کوچک

10- استفاده از ابزارها و زبانهای برنامهنویسی متعدد (پایتون،R، جاوا و...) توسط متخصصین علمداده

11- محدودیت ابزارهای تحلیلداده

موارد فوق تنها بخشی از چالش های تیم های علم داده در سازمان هاست که با بهرهگیری از متدها و روش های اصولی امکان مدیریت این مشکلات وجود دارد. مواردی همچون تدوین استراتژی های تحلیل داده، استقرار متدولوژی های حکمرانی داده و مدیریت داده و... نمونهای از این راهکارها خواهد بود.

در انتها این نکته قابل ذکر است که برخی از شرکتها و سازمان ها در تلاش هستند تا تمامی این چالش ها به صورت گام به گام و براساس دانش تیم های موجود برطرف گردد. این رویکرد سبب افزایش زمان پاسخگویی به مشکلات و به طبع کاهش اثربخشی تیم های علم داده خود می شود. بهره گیری از تجربیات مشاوران متخصص در امور علم داده (Data Science) میتواند در این مسیر بسیار راه گشا باشد.

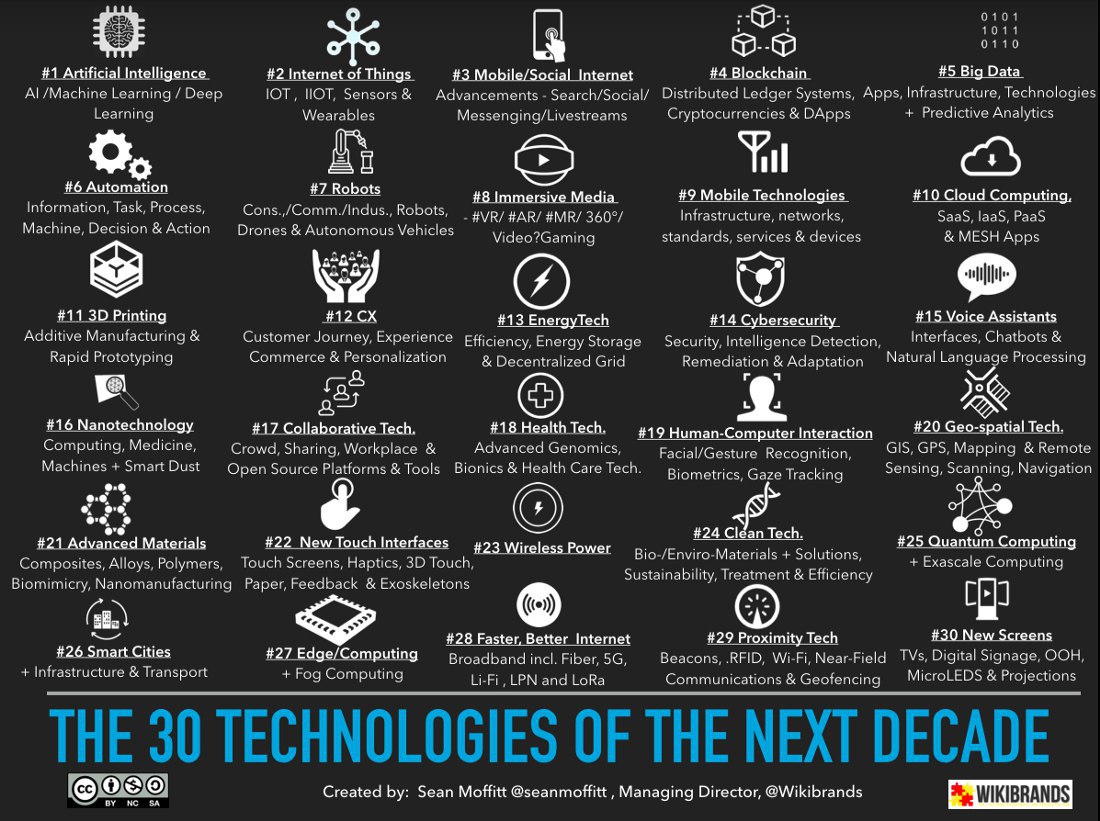

تکنولوژی های تاثیرگذار دهه آینده

در شکل زیر برترین تکنولوژی های تاثیرگذار طی دهه آینده معرفی شدهاند. حضور تکنولوژی های هوش مصنوعی، اینترنت اشیا، بلاکچین و کلان داده در رتبههای اول تا پنجم نشان از گسترش بازار کار این فیلدهای کاری طی سالیان آینده است. طراحی استراتژی بهینه توسعه محصولات و خدمات مرتبط با این تکنولوژی های نوظهور سبب افزایش موفقیت شرکتها و سازمانها در مواجهه با رقبا خواهد شد.

پرکاربردترین تکنیک های آماری در علم داده

یادگیری تخصصی تکنیکها و الگوریتمهای آماری همواره یکی از چالشهای متخصصین علمداده است. در ادامه 10 تکنیک پرکاربرد آمار در پروژههای علمداده و دادهکاوی معرفی میشوند.

1- رگرسیون خطی (Linear Regression)

2- الگوریتمهای طبقهبندی (Classification)

3- نمونهسازی (Resampling)

4- کاهش بعد (Dimension Reduction)

5- مدلهای غیرخطی (Nonlinear Models)

6- الگوریتمهای بدون نظارت (Unsupervised Learning)

7- الگوریتم ماشین پشتیبان بردار (SVM)

8- متدهای انتخاب زیرمجموعه (Subset Selection)

9- مدلهای مبتنی بر درخت (Tree-Based Methods)

10- روش Shrinkage

متدها و الگوریتمهای مورد نیاز در هر دسته با یکدیگر متفاوت است. آموزش هدفمند در هر یک از این موارد در گسترش دانش آماری علاقه مندان میتواند بسیار مفید باشد. در لینک زیر نیز یک جزوه تخصصی از مباحث آماری در یادگیری ماشین به زبان انگلیسی در 47 صفحه قابل دانلود است.

https://gwthomas.github.io/docs/math4ml.pdf

نویسنده مطلب:

مهندس محمدرضا محتاط